https://www.youtube.com/watch?v=kYRB-vJFy38

먼저 Langchain과 open AI를 인스톨 한다.

pip install langchain

pip install openai

(필요에 따라 langchain과 openai를 업그레이드 할 필요가 있음)

나는 openai api key 세팅을 아래와 같이 별도의 txt 파일에 두고 이를 불러와서 씀.

LangChain에 OpenAI key를 세팅하고 OpenAI에게 질문을 해서 답변을 받는 가장 간단한 코딩.

langchain.llms에 있는 OpenAI 모듈을 사용해서 api key를 세팅한 후 질문을 보내면 답변을 받을 수 있음.

위 코드는 파스타를 좋아하는 사람이 휴가때 가기 좋은 곳 5곳을 질문했고 그에 대한 답을 얻었음.

(변수 lim에 openAI 세팅이 되 있음. 원래는 llm 인데 lim 으로 오타가 난 것임. 참고 바람)

위 코드는 langchain의 PromptTemplate으로 프롬프트를 관리하는 간단한 예제이다.

위 예제에서는 질문 안에 있는 음식(food)을 변수로 처리해서 별도로 값을 입력 받아서 prompt를 완성할 수 있게 하는 소스코드임.

질문을 던질 때 food에 dessert를 넣어서 디저트를 좋아하는 사람이 갈만한 휴가 장소 5곳을 물었고 그에 대한 답을 OpenAI로 부터 받았음.

위 코드는 langchain.chains 의 LLMChain 을 사용해서 OpenAI에 질문을 던지는 방법을 보여 준다.

소스코드가 하는 일은 위와 같다.

이번에는 food에 fruit을 넣어서 질문을 했고 위와는 다른 답변을 얻어 냈다.

다음은 Agents 에 대해 살펴 본다.

google-search-results 모듈을 인스톨 한다.

필요한 모듈을 import 한다.

그리고 llm 변수에 OpenAI 모델을 load 한다.

참고로 open_file() 함수는 위에 세팅해 두었던 것인데 이 부분을 따로 사용하려면 아래 함수를 넣는다.

def open_file(filepath) :

with open(filepath, 'r', encoding='utf-8') as infile :

return infile.read()그 다음 필요한 툴을 로드한다.

# Load in some tools to use

# os.environ["SERPAPI_API_KEY"] = "..."

tools = load_tools(["serpapi", "llm-math"], llm=llm)

이 모듈을 실행하려면 SerpAPI 계정이 있어야 한다. 이 서비스는 유료인 것 같음.

# Finally, let's initialize an agent with:

# 1. The tools

# 2. The language model

# 3. The type of agent we want to use.

agent = initialize_agent(tools, llm, agent="zero-shot-react-description", verbose=True)이제 agent를 초기화 한다.

initialize_agent() 메소드를 사용하고 파라미터로 tools와 llm 그리고 agent 를 전달한다.

Agent Type들에는 여러개가 있는데 자세한 사항은 아래 페이지에서 보면 된다.

https://python.langchain.com/docs/modules/agents/agent_types/

Agent Types | 🦜️🔗 Langchain

Agents use an LLM to determine which actions to take and in what order.

python.langchain.com

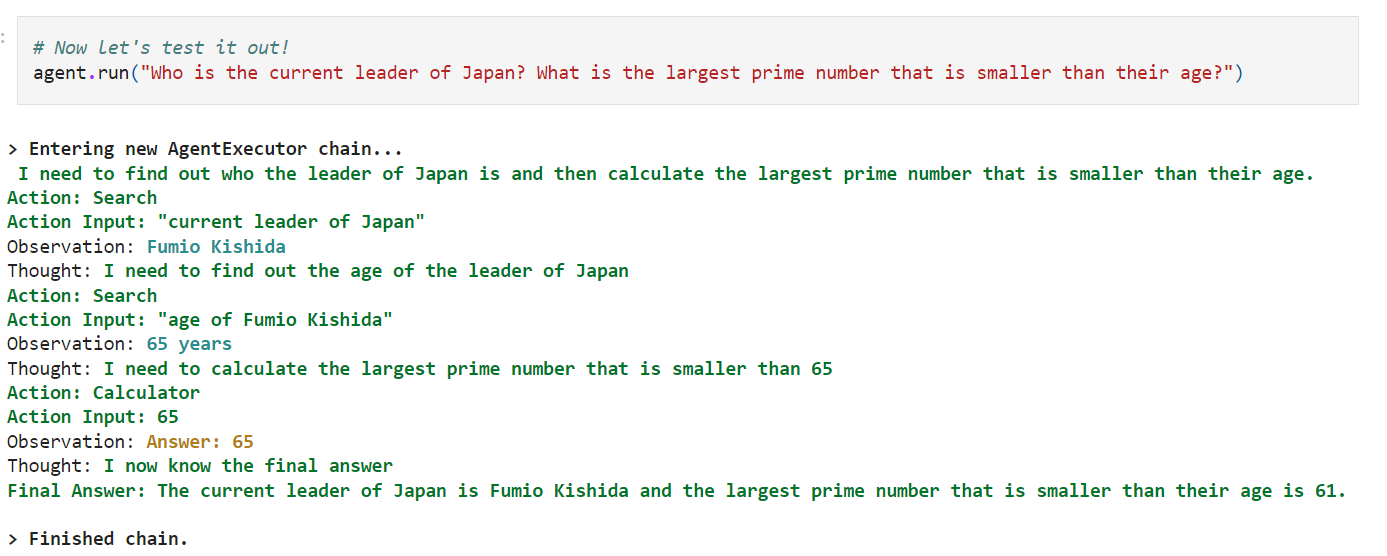

# Now let's test it out!

agent.run("Who is the current leader of Japan? What is the largest prime number that is smaller than their age?")

이제 이 agent를 run 하면 된다. 이때 원하는 prompt를 전달한다.

prompt에는 두가지 질문이 있다. 일본의 현재 리더는 누구인가? 그리고 나이보다 작은 가장 큰 소수는 무엇입니까? 이다.

위 유투브 클립에서는 아래와 같은 답변을 얻어 냈다.

위 질문에 답변을 하기 위해 이 agent 는 여러 일을 하게 된다.

처음에 자기가 할 일을 얘기한다. 이 agent 가 할 일은 일본의 수상이 누구인지 찾고 그 수상의 나이를 찾아서 그 나이보다 작은 가장 큰 소수를 찾는 일을 하는 것이다.

처음 질문에 대한 답변은 Fumio Kishida이다.

그 다음 이 수상의 나이를 찾아야 한다. age of Fumio Kishida. 나이는 65세이다.

그리고 나서 65보다 작은 가장 큰 소수를 찾는 거다.

65가 소수이기 때문에 답은 65 이다.

그리고 나서 final answer를 내 놓는다.

이 작업은 chain을 통해 이루어 진다.

다음은 Memory에 대해서 알아본다.

우선 ConversationChain 모듈을 import해야 한다.

그 다음 OpenAI를 세팅하고 나서 ConversationChain을 초기화 한다.

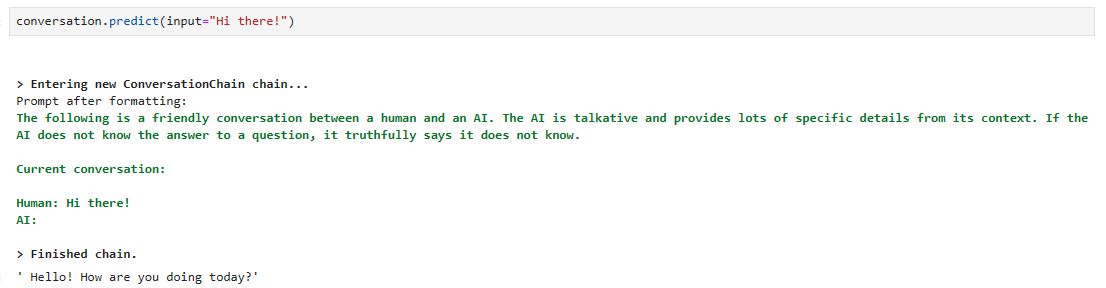

그 다음 predict() 메소드를 사용해서 실행한다. 결과는 다음과 같다.

conversation.predict(input="Hi there!")

Hi there라는 프롬프트를 보냈더니 자기가 알아서 prompt를 포맷해서 전달합니다.

prompt 앞에 이 시스템 조건을 붙입니다.

The following is a friendly conversation between a human and an AI. The AI is talkative and provides lots of specific details from its context. If the AI does not know the answer to a question, it truthfully says it does not know.

다음은 인간과 AI의 친근한 대화이다. AI는 말이 많고 상황에 맞는 구체적인 세부 정보를 많이 제공합니다. AI가 질문에 대한 답을 모른다면, 사실은 모른다고 말합니다.

그 다음 전달한 prompt 'hi there!를 붙입니다.

그럼 답변으로 Hello! How are you doing today? 를 받았습니다.

conversation.predict(input="I'm doing well! Just having a conversation with an AI.")

그 다음 이어서 질문을 합니다.

그러면 이전 prompt에다가 현재의 prompt를 추가해서 보냅니다.

이렇게 함으로서 대화가 맥락이 끊기지 않고 계속 이어질 수 있도록 합니다.

맥락이 끊어지지 않도록 하기 위해서 이전 prompt를 계속 memory 하게 됩니다.

이 일을 하는게 ConversationChain입니다.

conversation.predict(input="what is an alternative phrase for the first thing I said to you?")그 다음. 내가 너한테 맨 먼저 한 말이 뭐지? 라고 물어봅니다.

맨 먼저 한 말은 Hi there! 였고 OpenAI는 잘 대답합니다.

대화들을 계속 기억하고 있다는 이야기 입니다.

그 다음에는 그 내가 맨 처음 한 얘기는 어떤 의미인지에 대해 질문합니다.

conversation.predict(input="what is an alternative phrase for the first thing I said to you?")

OpenAI 는 Hi there!는 그냥 인사말이었다고 답변을 하네요.

뭔가 대화가 되어 가는 느낌 입니다.

이상 Greg Kamradt 가 운영하는 채널에 있는 LangChain 101: Quickstart Guide를 살펴 봤습니다.